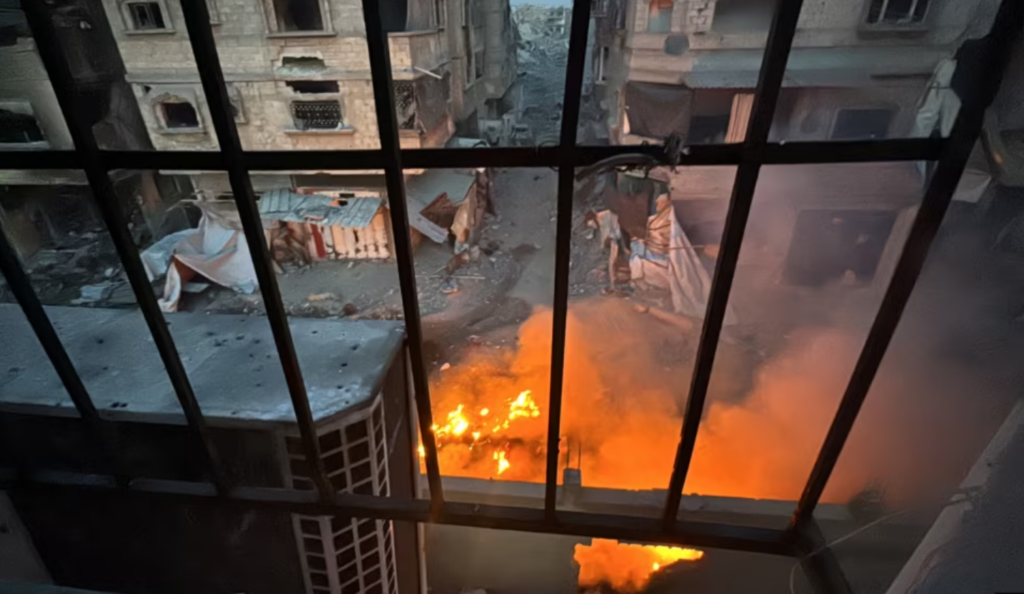

Në një zhvillim të fundit, një sistem i avancuar i inteligjencës artificiale (AI) i quajtur Lavender është përdorur nga ushtria izraelite për të identifikuar objektiva të lidhura me grupet militante në Gaza. Sipas raporteve, ky sistem ka mundësuar identifikimin e mbi 37,000 objektivave të dyshuara, duke përfshirë operativë të mundshëm të Hamasit dhe Xhihadit Islamik Palestinez.

Raportet vijnë nga burime të inteligjencës që kanë qenë pjesë e operacioneve dhe tregojnë se Lavender ka luajtur një rol të rëndësishëm në përpunimin e të dhënave për të ndihmuar në luftën e vazhdueshme. Megjithatë, ka shqetësime të thella mbi numrin e civilëve që mund të kenë humbur jetën si rezultat i përdorimit të këtij sistemi, veçanërisht gjatë fazave të hershme të konfliktit.

Njësia 8200, një divizion elitar i inteligjencës së Forcave të Mbrojtjes të Izraelit, ka zhvilluar Lavender, i cili është krahasuar me Agjencinë e Sigurisë Kombëtare të SHBA-së dhe GCHQ në Mbretërinë e Bashkuar. Përdorimi i Lavender ka ngritur pyetje ligjore dhe morale, duke sfiduar marrëdhëniet tradicionale midis personelit ushtarak dhe teknologjisë.

Në një intervistë të rrallë, oficerë të inteligjencës kanë shprehur besimin e tyre në sistemin AI, duke e përshkruar atë si më të besueshëm se gjykimi njerëzor në disa raste. Megjithatë, ka pasur edhe shqetësime për rolin e zvogëluar të njeriut në procesin e vendimmarrjes, me disa duke e përshkruar veten si të reduktuar në një “vulë miratimi” për objektivat e identifikuara nga AI.